让模型更易用,让创作更自由

模型托管

安全托管,轻松版本化,让模型像代码一样流动

模型/数据集加速

全球分发,瞬间加载,让下载等待成为过去式,专注创新

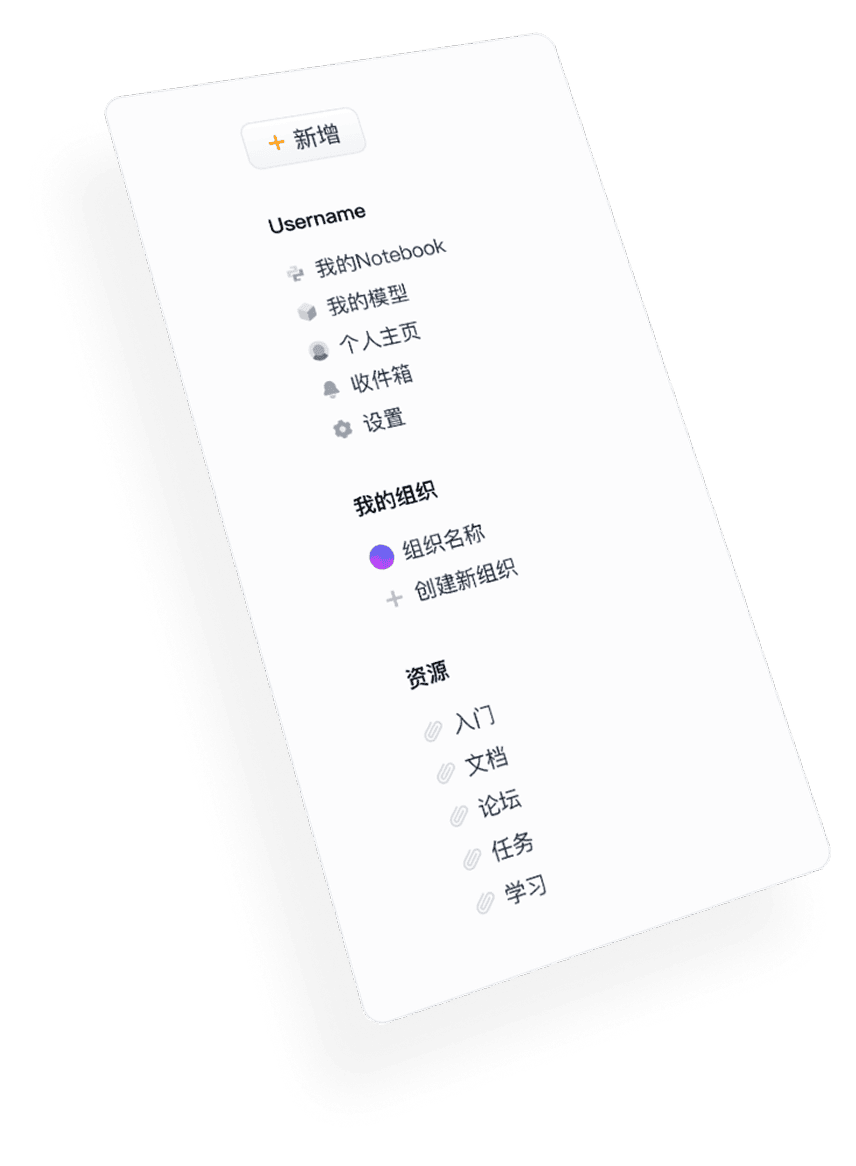

开发者个人工作台

一站式管理与展示,让 AI 创作更有序、更出彩

模型使用

多样化体验方式,随时随地解锁 AI 能力

社区活动

活力四射的开发者社区,挑战赛、协作项目与开放交流,让创意在共创中走向世界

让模型更易用,让创作更自由

模型托管

安全托管,轻松版本化,让模型像代码一样流动

模型/数据集加速

全球分发,瞬间加载,让下载等待成为过去式,专注创新

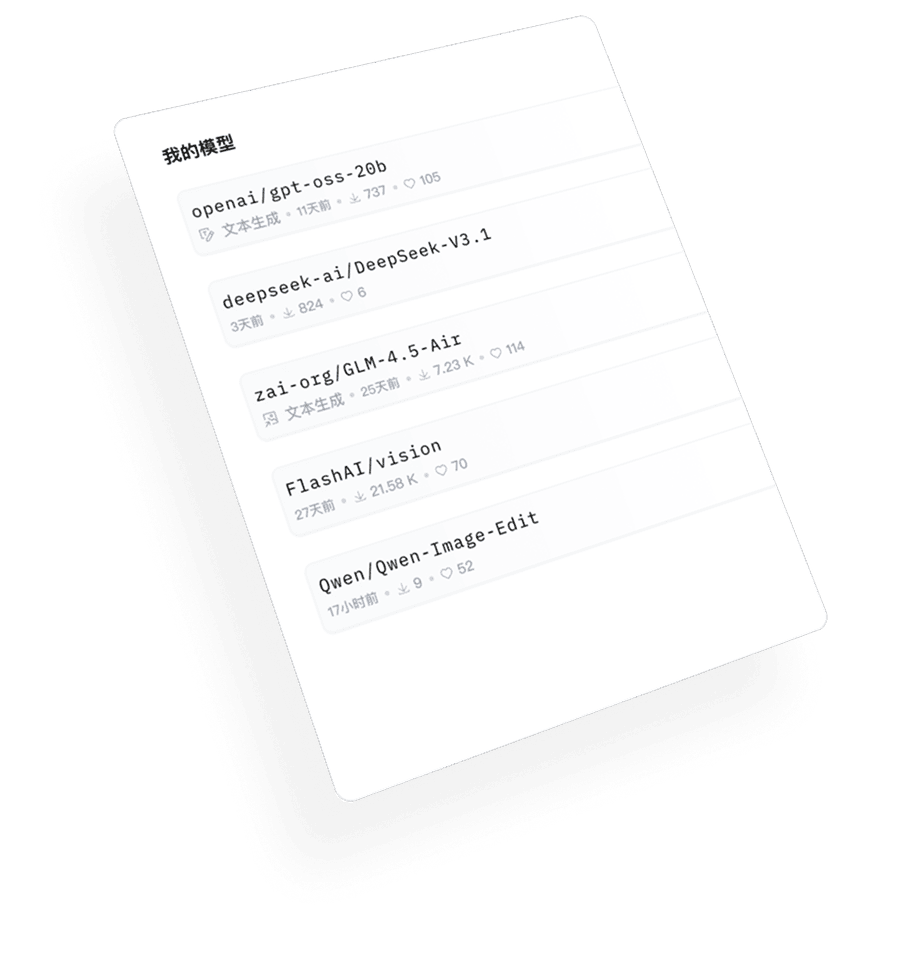

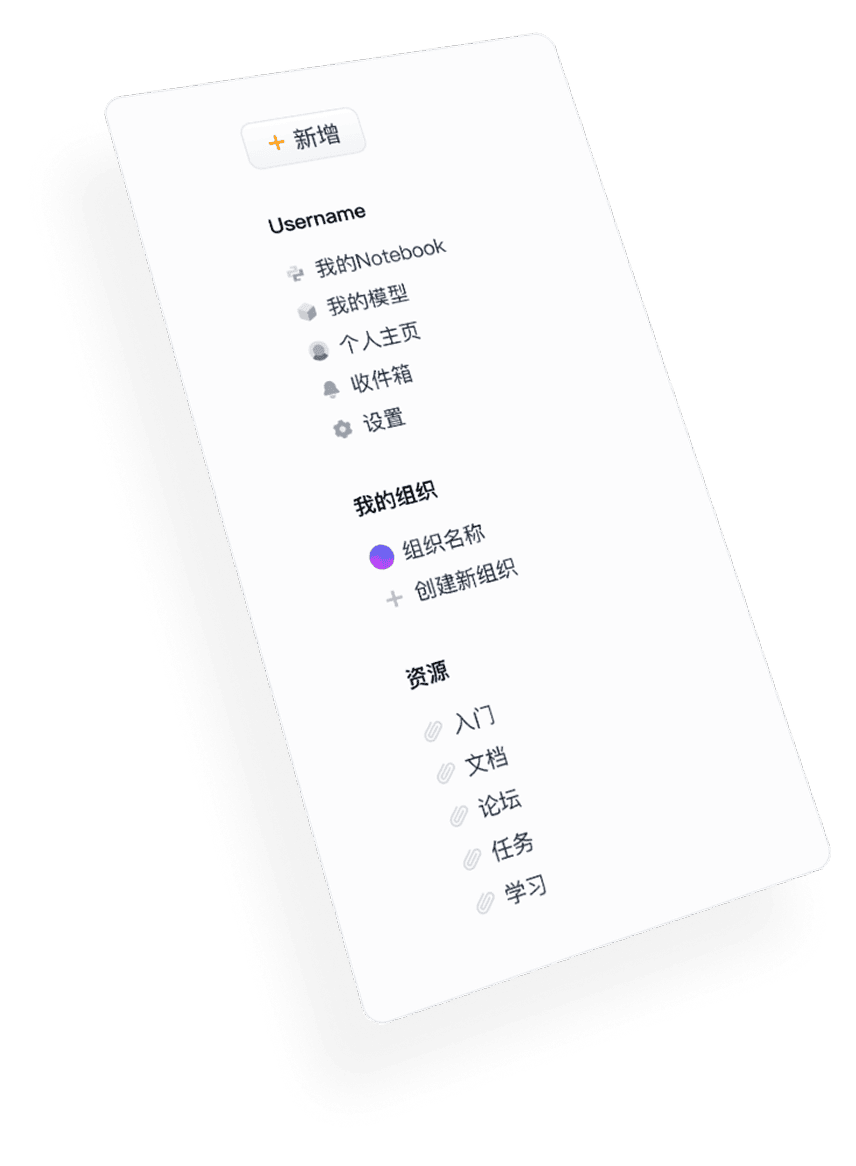

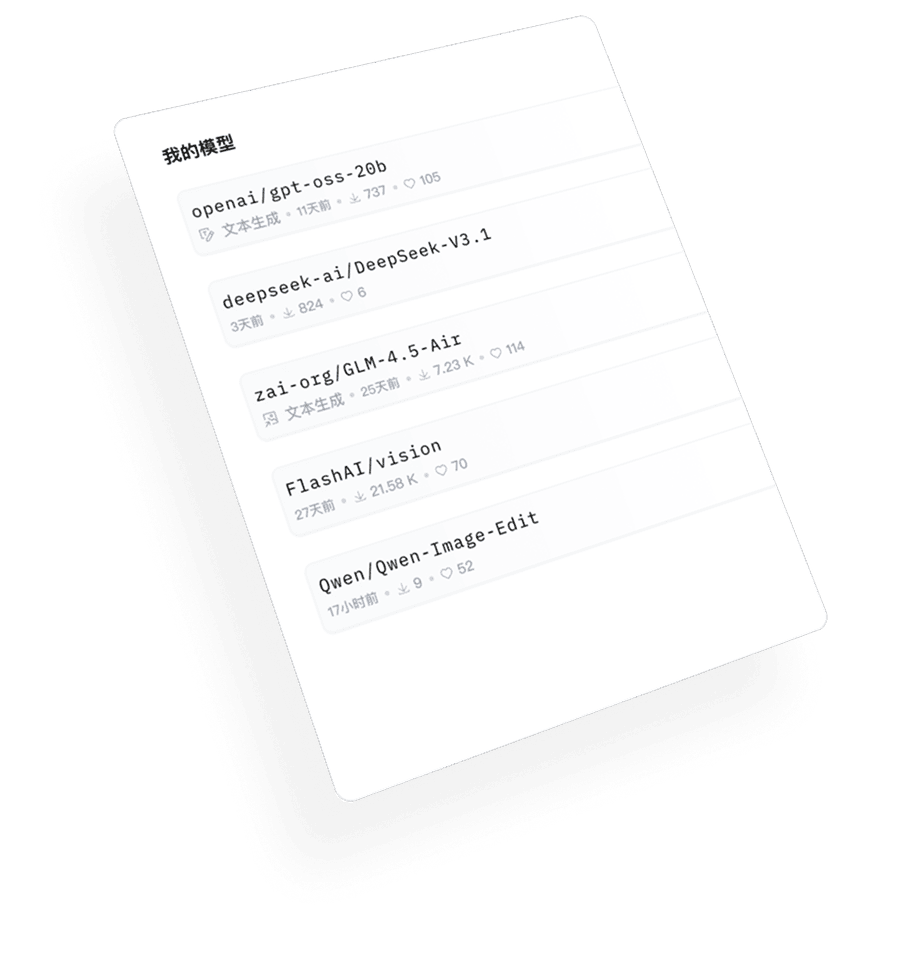

开发者个人工作台

一站式管理与展示,让 AI 创作更有序、更出彩

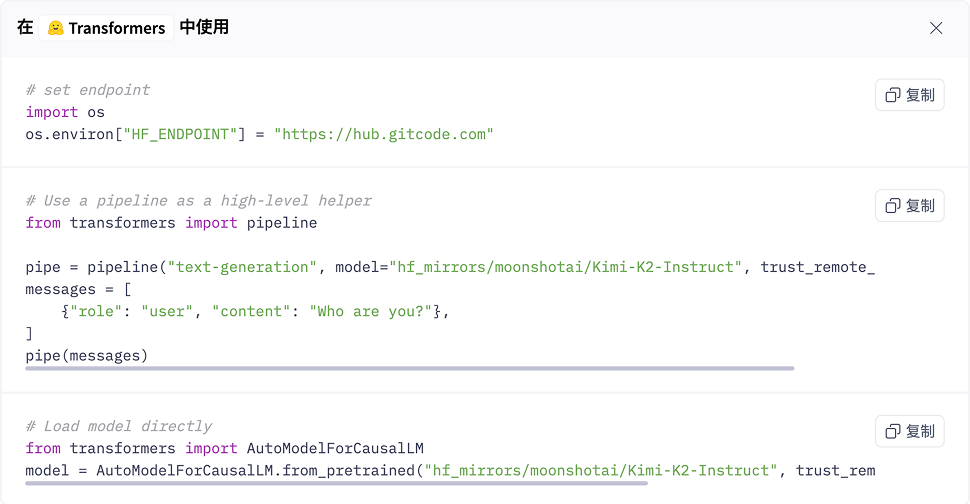

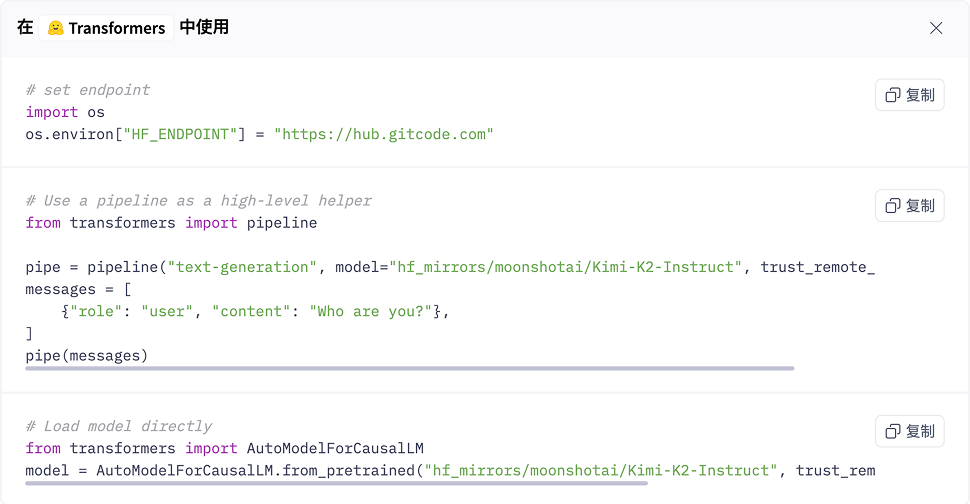

模型使用

多样化体验方式,随时随地解锁 AI 能力

社区活动

活力四射的开发者社区,挑战赛、协作项目与开放交流,让创意在共创中走向世界

发现、分享、部署最先进的AI模型、数据集和应用

DeepSeek-V4-Pro

DeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。

DeepSeek-V4-Flash

DeepSeek-V4-Flash(总参数 284B,激活 13B)主打极致性价比,推理成本仅为前代的十分之一,适合高频对话和大规模部署。两个版本均支持 Thinking/Non-Thinking 双模式,通过创新的混合注意力架构(CSA+HCA)实现 1M 上下文下 10 倍以上的推理效率提升。

MiniCPM5-1B

MiniCPM5-1B,这是 MiniCPM5 系列的首款模型。它是一个专为端侧、本地部署和资源受限场景打造的 10 亿参数密集型 Transformer 模型,达到了 10 亿参数级开源模型的 SOTA 水平

Step-3.7-Flash

Step-3.7-Flash是一个拥有 1980 亿参数的稀疏混合专家(MoE)视觉语言模型,由 1960 亿参数的语言主干网络和 18 亿参数的视觉编码器组合而成,具备原生图像理解能力。

LongCat-Video-Avatar-1.5

最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。